在AI人工智能飞速发展的今天,近年大模型成了备受瞩目的焦点。基于大模型衍生出来了很多新产品形态和新商业模式,包括智能体AI Agent、RAG(Retrieval-augmented Generation,检索增强生成)、文生内容文生音频文生视频等,AI 正加速从理论研究迈向大规模的实际应用,深度融入各个行业领域,推动生产力变革。

本文以非技术的通俗语言让大家快速了解大模型和Al关系!

一.AI和大模型

人工智能AI是一种模拟人类智能的计算机系统,其目标在于使机器能够像人一样进行思考、学习和自主决策,AI 涵盖了算法、数据处理、计算机视觉、自然语言处理等多个领域。

AI和大模型有重叠的地方,但它们在一些核心方面存在区别:

1.范围和功能:AI是一个更广泛的概念,涵盖了所有模拟人类智能的技术和系统,而近期快速崛起的大模型则是AI技术中的一种特定实现,相对传统的AI实现技术,大模型应该算是实现复杂AI功能落地的一种最佳方案。可以认为所有大模型都属于AI的范畴,但并非所有AI系统都一定是大模型。

2.复杂性:大模型通常具有更高的复杂性和数据需求,需要的参数数量非常庞大,训练过程需要大量计算资源与数据,而一些传统的AI技术如规则引擎、决策树等虽然功能可能不如大模型,但在特定场景下可以更快速、更简洁和更高效地实现目标。

3.学习能力:大模型往往依赖深度学习技术,具有自我学习、自我训练和适应能力,能在接触新数据后主动调整其表现,真正象人类一样学习并不断提高自己;而许多传统的AI方法则以静态算法为主,无法进行动态适应。

二.2C和2B对AI和大模型的反应

大模型和AI竞争激烈,参与企业众多,呈现出百芯百模的竞争态势。不少企业已筹划建立智算中心,其核心任务是承载AI大模型的训练及推理等,为各行各业提供便捷、高效、领先和普惠的多元化“算力服务”,大模型作为智算时代的核心“产物”被大家广泛关注。

2C领域的各大科技巨头到初创企业,都在更积极探索大模型的潜力,互联网巨头凭借海量数据优势,在智能语音、图像识别、自然语言处理等领域打造出具有国际竞争力的产品与服务;新兴的 AI 创业公司如雨后春笋般涌现,聚焦于特定行业应用场景如智能制造、智慧医疗、智能交通等领域。互联网公司和科技公司干AI商业模式增长的新引擎,以期在未来的市场竞争中占据有利地位。

2B领域里,近期国资委频频点题人工智能鼓励“国家队”带头加速布局AI产业。 2B的数据相对机密但相对互联网爬取的数据会相对精准!

三.大模型概念和分类

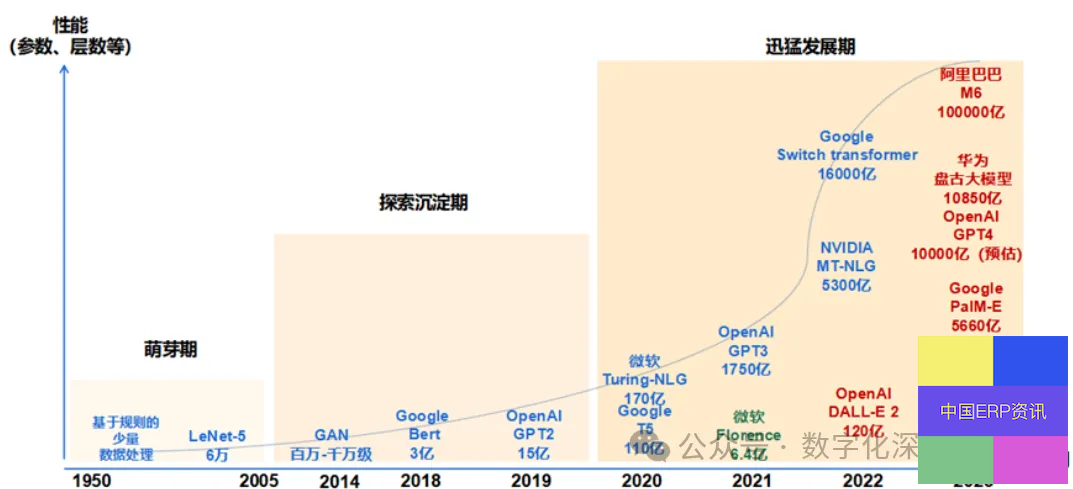

大模型(Large Models):大模型通常指的是具有大量参数的机器学习模型特别是深度学习模型。

大模型的特点是参数数量巨大,通常在百万到数十亿级别;能够处理和理解大量的数据;通常具有较高的泛化能力,能够处理未见过的新数据。

大模型发展历程:

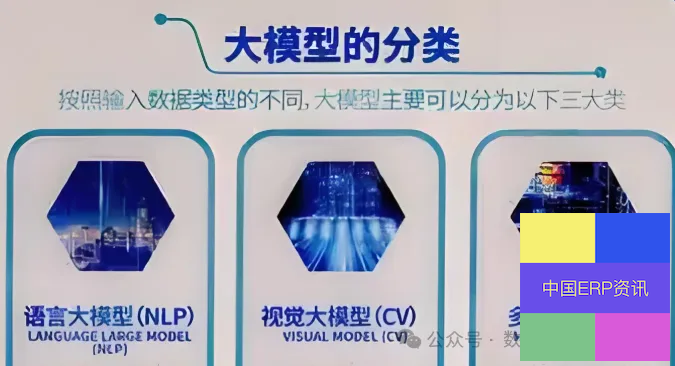

大模型分类

(1).大模型按输入数据类型分为语言大模型(NLP 大模型,其代表为LLM)、视觉大模型(CV )和多模态大模型;

大模型技术在语音识别、自然语言处理、计算机视觉等任务中已经具有相当高的准确率,泛化性能强,在不同任务、语言、模态、场景的通用性都变得越来越好。

LLM和NLP

LLM 是 Large Language Model大语言模型的缩✍,LLM是一种基于深度学习的自然语言处理(NLP)大模型工具,能理解和生成文本。通过大量语料库训练,LLM 在翻译、写作、对话等任务中展现出卓越的能力。常见的应用包括自动问答、生成文本、文本摘要等。由于其多模态特性,LLM 还可用于图像和音频处理,为多领域带来创新可能。

(2).大模型按应用领域分为通用大模型(L0)、行业大模型(L1)和垂直大模型(L2)。

通用大模型(General-Purpose Large Models):通用大模型是指设计用来处理多种任务的模型,而不是专门针对某特定应用,它们通常在大规模数据集上进行预训练,并可在多种不同的任务上进行微调。

ChatGPT、豆包、文心、Deepseek等就是一种通用大模型!

垂直大模型(Vertical Large Models):

垂直大模型是指针对特定行业或领域(垂直市场)优化的模型。这些模型在特定领域的数据上进行训练,以更好地适应该领域的特定需求。

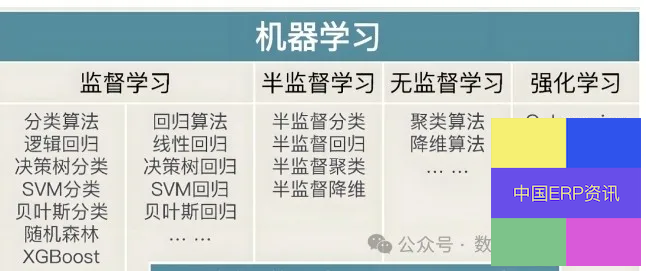

四.机器学习ML、深度学习DL

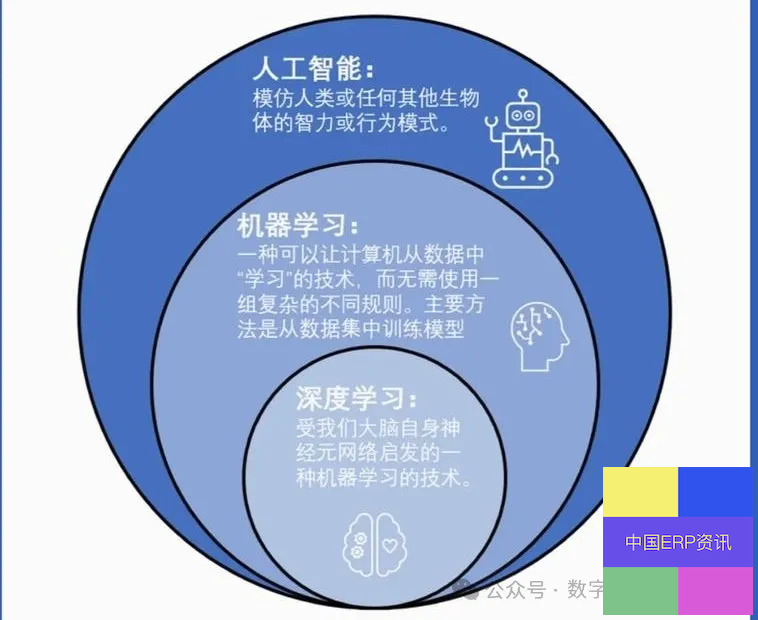

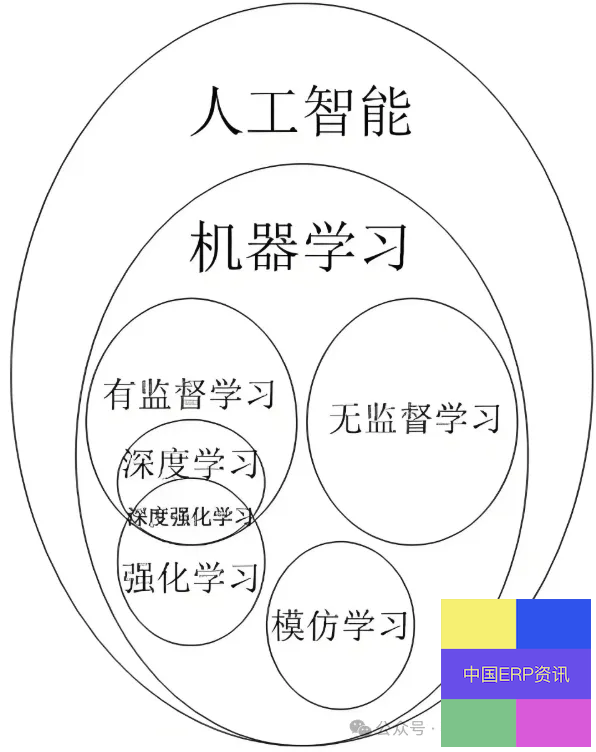

前面讲过大模型通常指的是具有大量参数的机器学习模型特别是深度学习模型。接下来聊下ML和DL,AI同ML/DL关系如下图。

深度学习是机器学习的一个子集,可以认为深度学习(DL)是机器学习(ML)的一种发展和分支。深度学习属于有监督学习,深度学习和强化学习(DQM)演化为深度强化学习。

深度学习是机器学习的一个子集,可以认为深度学习(DL)是机器学习(ML)的一种发展和分支。深度学习属于有监督学习,深度学习和强化学习(DQM)演化为深度强化学习。

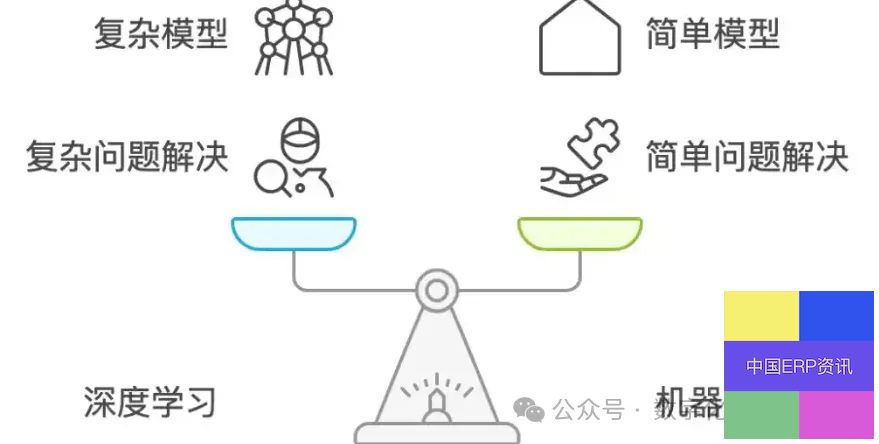

深度学习看作是机器学习技术的进化版本,深度学习采用了更为复杂的模型和算法,专注于解决那些传统机器学习方法无法处理的复杂问题。

深度学习的根基是人工神经网络(ANN),它模拟人类大脑中神经元的结构与功能,神经网络由多个层次组成,每个层次包括多个节点/神经元,这些节点通过连接形成网络,数据在这些节点之间传递、处理并最终产生输出。

人脑是人类思维的物质基础,光人类的大脑皮层就含有大约10^11个神经元,每个神经元又通过神经突触与大约103个其它神经元相连,形成一个高度复杂高度灵活的动态网络,如果说人脑是生物神经网络,电脑神经网络是人类发明的人工智能机器神经网络,起码截止到目前,人工智能还被人类操控,至于发展到一定阶段,人工智能有了自我意识能否取代人类,未来谁也不能确定!

神经网络(Neural Networks,简称NN)有三基本层,如下图所示:

输入层:负责接收外部输入的数据。

隐藏层:数据在这里进行处理和转换。通常,神经网络会包含多个隐藏层,因此深度学习也得名“深度”。

输出层:产生最终结果或预测。

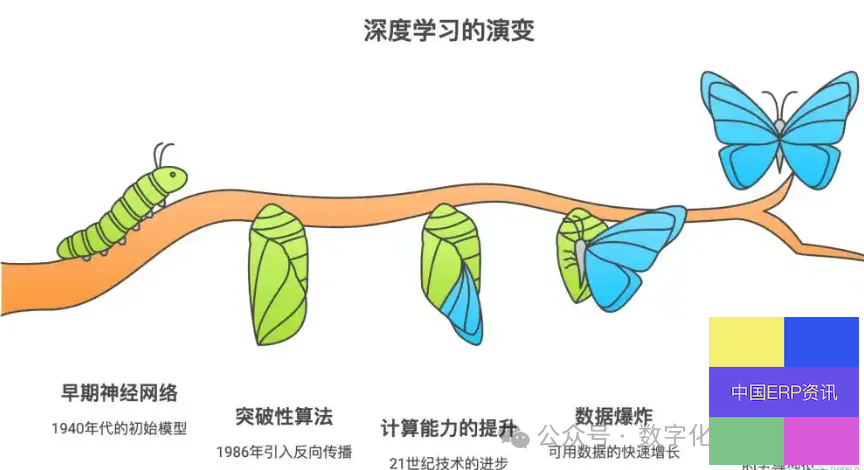

从早期的神经网络到现在的深度学习的演变历程:

深度学习起源可以追溯到20世纪40年代的早期神经网络,当时科学家们通过模拟大脑的神经元网络,提出了最早的人工神经网络模型。但真正的突破发生在1986年,当时反向传播算法的提出,让神经网络能够通过多层结构不断“学习”并调整权重,这一技术突破为如今的深度学习的兴起奠定了基础;进入21世纪后,随着计算能力的提高和数据量的爆炸式增长,深度学习得到迅猛发展,从图像分类到自然语言处理,深度学习几乎覆盖了所有领域,并快速崛起为人工智能的核心技术。

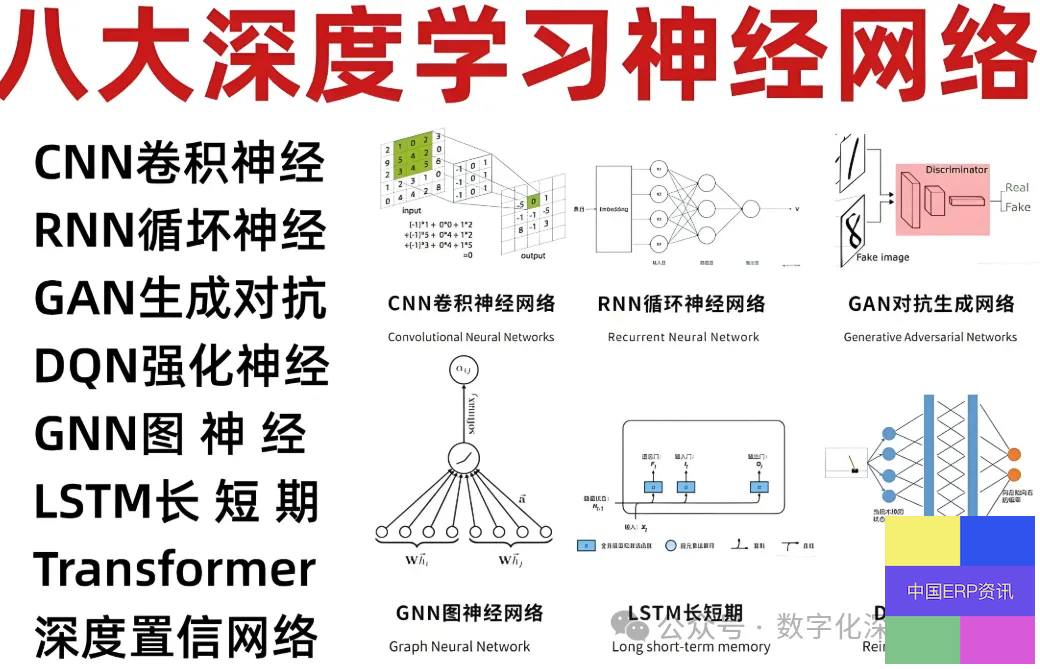

主流八大深度学习神经网络:

神经网络(Neural Networks,简称NN)目前有八种主流方式。

最常见的是卷积神经网络(CNN)、深度神经网络(DNN)的近期热炒的Transformer,它们各自有不同的“技能树”,比如CNN特长图像处理,DNN更擅长抽象特征学习。

好了,简单总结:

可以简单认为,利用神经网络深度学习的大模型是目前实现复杂人工智能的一种优秀技术方案!记住这句话即可,还有其他简单的人工智能技术实现方式,未来是不是有更好的Al技术实现方案再说,据未来学家推测,强人工智能到来,出现智商超10000的碳硅基混合生命,不用寒窗苦读几十载,幼儿园毕业连下脑机接口到"超智系统”,setup/install充一下"智商值",其知识储备就相当于目前全人类院士掌握的知识总和!

硅基生命或是人类进化的新形态?为何说宇宙的天道,是碳硅结合?

五.大模型/Al三要素

算力:GPU是关键

数据:或称语料,如果数据本身缺乏,或者质量低劣,大模型实现的Al就不是人工智能,而是人工智障。

这点2B的数据相对会精准一点,毕竟企业同互联网不一样,企业数据有人维护。但亦不绝对,试想一下,多少上市公司连财务数据都敢明目张胆造假,粉饰财报更是家常便饭;2C就更扯蛋,Al的发展本意是好的,近几天Deepseek🔥了,需知不久前DeepFake亦曾🔥过! 本人一直强调,基础不牢地动山摇,2B国产化替代连工业软件都没整好,其上的数据(语料、原料)→大模型→人工智能可能会如同建立在沙滩的大厦!

算法:大模型涉及的DL/ML包括但不限于下图。

一文带你了解更多大模型概念(预训练、剪技、知识蒸馏等)

从数字孪生、CPS、GlS到不久前热炒的元宇宙,目前科技大佬们正在构思元宇宙和Al技术融合形成世界大模型,想象一下,将真实世界虚拟到数字化的全球大模型,就问:这个饼画的大不大?谁来买单?资本的噱头?

大数据还没炒完,大模型又来了!感觉科技已被资本绑架,炒炒更健康!Al领域群雄并起,未来三年,国内国外市场血拼到底,谁能笑到最后?

全球具身大模型详细梳理(大佬谈全球大模型)